SPRACHE:

- WAS WIR TUN

- GENERATIVE KI

Wir erstellen, verwandeln, testen und vermitteln mehr Inhalte als jeder andere Anbieter weltweit – von Texten, Inhalten gesprochener Art, Audioinhalten und Videoinhalten bis hin zu strukturierten und unstrukturierten Daten.

Lionbridge Knowledge Hubs

- Positive Patientenergebnisse

- Die Zukunft der Lokalisierung

Nutzen Sie die KI-gestützte Technologie, um Ihre globale Kommunikation zu verbessern.

- BRANCHEN

- LAⁱNGUAGE CLOUD™

- WER WIR SIND

Unsere Experten kennen sich bestens mit Ihrer Branche und deren speziellen Herausforderungen aus.

Nutzen Sie die Lionbridge Lainguage Cloud zur Unterstützung Ihres gesamten Lokalisierungs- und Content-Lebenszyklus

Wir erstellen, verwandeln, testen und vermitteln mehr Inhalte als jeder andere Anbieter weltweit – von Texten, Inhalten gesprochener Art, Audioinhalten und Videoinhalten bis hin zu strukturierten und unstrukturierten Daten.

Content-Services

- Technische Redaktion

- Schulungen und E-Learning

- Finanzberichte

- Digitale Erlebnisse messen

- Digitales Marketing

- Content-Optimierung

Übersetzung und Lokalisierung

- Videolokalisierung

- Software-Lokalisierung

- Website-Lokalisierung

- Übersetzung für regulierte Branchen

- Dolmetschen

- Live Events

Testdienstleistungen

- Testservice

- Kompatibilitätsprüfungen

- Interoperabilitätsprüfungen

- Performance-Tests

- Zugänglichkeits-Tests

- Überprüfen des Kundenerlebnisses

Lösungen

- Übersetzungsservices

- Maschinelle Übersetzung

- Smart Onboarding™

Unsere Knowledge Hubs

- Positive Patientenergebnisse

- Die Zukunft der Lokalisierung

- Mit Innovation zur Immunität

- Covid-19-Sprachressourcen

- Disruption Series

- Patienteneinbindung

- Lionbridge Insights

Nutzen Sie die KI-gestützte Technologie, um Ihre globale Kommunikation zu verbessern.

Generative KI

KI-Marketinglösungen

Unsere Experten kennen sich bestens mit Ihrer Branche und deren speziellen Herausforderungen aus.

Life Sciences

- Pharmazeutische Übersetzungsdienste

- Klinisch

- Regulierung

- Nach der Zulassung

- Für Unternehmen

- Übersetzungsdienste für Medizinprodukte

- Validierung und klinische Untersuchungen

- Regulierung

- Nach der Autorisierung

- Für Unternehmen

Bank- und Finanzwesen

Einzelhandel

Luxusgüter

E-Commerce

Lionbridge Games

Automobilbranche

Konsumgüter

Technologie

Industrielle Fertigung

Rechtsdienstleistungen

Tourismus und Gastgewerbe

Nutzen Sie die Lionbridge Lainguage Cloud zur Unterstützung Ihres gesamten Lokalisierungs- und Content-Lebenszyklus

Lainguage Cloud™ Plattform

Konnektivität

Translation Community

Workflow Technology

Smairt Content™

Smairt MT™

Smairt Data™

Unsere Mitarbeiter sind unser ganzer Stolz und helfen Unternehmen seit mehr als 20 Jahren dabei, Kunden zu begeistern.

SPRACHE AUSWÄHLEN:

Wie sieht die Zukunft der maschinellen Übersetzung (Machine Translation, MT) aus? Mit dieser Frage beschäftigen wir uns bei Lionbridge tagtäglich.

Die wichtigsten MT-Engines – Google NMT, Bing NMT, Amazon, DeepL und Yandex – haben 2022 nur geringe bis gar keine Qualitätsfortschritte gemacht. Mit einem Blick auf unseren Machine Translation Tracker, den ältesten MT-Tracker in der Branche, können Sie sich ganz schnell selbst davon überzeugen. Diese ernüchternden Ergebnisse haben uns dazu veranlasst, einige Fragen zum aktuellen Paradigma der neuronalen maschinellen Übersetzung (Neural Machine Translation, NMT) zu stellen.

- Stagniert das NMT-Paradigma?

- Ist angesichts der Tatsache, dass die Engines keine wesentlichen Fortschritte mehr erzielen, ein generelles Umdenken erforderlich?

- Was könnte als Nächstes kommen?

Wir gehen jede Wette ein, dass große Sprachmodelle (Large Language Models, LLMs) mit ihren riesigen Mengen an Inhalten, einschließlich Multimodalität und Mehrsprachigkeit, künftige Paradigmen bestimmen werden. Warum sind wir davon überzeugt? Weil wir die Übersetzungsleistung von ChatGPT mit der Performance von MT-Engines direkt miteinander verglichen haben. Und die Ergebnisse dieser bahnbrechenden Analyse sprechen für sich.

ChatGPT, die neueste Version von OpenAIs GPT-3-Familie von LLMs, lieferte zwar schlechtere Ergebnisse als die spezifischen MT-Maschinen, doch der Unterschied war gering. Die Leistung des Bots war schlichtweg bemerkenswert und hat zweifellos Auswirkungen auf die Zukunft der maschinellen Übersetzung.

Könnte ein neues Paradigma der maschinellen Übersetzung entstehen?

Die aktuellen Trends bei den MT-Engines vermitteln uns ein Gefühl von Déjà-vu.

Das Ende der statistischen maschinellen Übersetzung (Statistical Machine Translation, SMT) zeichnete sich auch dadurch ab, dass es bei der Qualität zuletzt kaum noch Veränderungen gab. Darüber hinaus haben sich die verschiedenen MT-Engines qualitativ angenähert. Das gleiche Muster zeigt sich auch jetzt.

Auch wenn die NMT nicht in Kürze ersetzt werden wird: Wenn wir an die Theorie des exponentiellen Wachstums und immer höherer Renditen glauben und wenn wir die 30-jährige Erfolgsgeschichte der regelbasierten MT und die jahrzehntelange Bedeutung der SMT in Betracht ziehen und dabei bedenken, dass sich die NMT jetzt im sechsten Jahr befindet, ist ein neuer Paradigmenwechsel vielleicht gar nicht so weit entfernt.

Was könnte das nächste Paradigma sein?

Wichtige Fortschritte bei LLMs im Jahr 2022 haben die Technologie darauf vorbereitet, 2023 in den Bereich der maschinellen Übersetzung einzutreten.

LLMs sind generische Modelle, die für viele unterschiedliche Aufgaben trainiert wurden. Ende 2022 konnten wir jedoch feststellen, dass einige spezielle – oder feiner abgestimmte – LLMs in einigen spezifischen Bereichen wesentliche Fortschritte gemacht haben. Diese Entwicklungen versetzen die Technologie in die Lage, mit zusätzlichem Training Übersetzungen durchzuführen.

Nehmen wir zum Beispiel ChatGPT. OpenAI hat dieses neueste Modell so konfiguriert, dass es Frage-und-Antwort-Dialoge führen kann und gleichzeitig in der Lage ist, all das zu tun, wozu auch generische LLMs fähig sind.

Etwas Ähnliches könnte in Bezug auf Übersetzungen geschehen – mit LLMs, die für Übersetzungen feinabgestimmt sind.

Inwiefern müssen große Sprachmodelle für das Übersetzen konfiguriert werden?

Um LLMs für die Übersetzung zu nutzen, müssen die Maschinen mit einem ausgewogeneren Sprachkorpus trainiert werden.

Der Trainingskorpus von GPT-3 bestand zu 93 % aus Englisch; nur 7 % stammen von anderen Sprachen. Wenn GPT-4, dessen Veröffentlichung kurz bevorsteht, mehr Informationen aus nicht englischen Sprachen enthält, könnten wir schon bald LLMs sehen, die besser in der Lage sind, Mehrsprachigkeit und damit auch Übersetzungen zu bewältigen. Ein derart ausgewogenerer Sprachkorpus könnte die Grundlage für den Aufbau eines feinabgestimmten, auf die Übersetzung spezialisierten Modells sein.

Ein weiterer interessanter Aspekt dieses hypothetischen neuen MT-Paradigmas auf der Grundlage von LLMs ist der Trend zur Multimodalität. Wir könnten LLMs mithilfe von linguistischen und anderen Trainingsdaten, wie etwa Bildern und Videos, trainieren und so zusätzliches Weltwissen für bessere Übersetzungen bereitstellen.

Wären große Sprachmodelle eine gute Alternative zum Paradigma der neuronalen maschinellen Übersetzung?

Um zu bewerten, ob LLMs das NMT-Paradigma wirklich ersetzen können, haben wir die Übersetzungsleistung von ChatGPT mit der Leistung der fünf wichtigsten MT-Engines verglichen, die wir auch in unserem MT Quality Tracking verwenden.

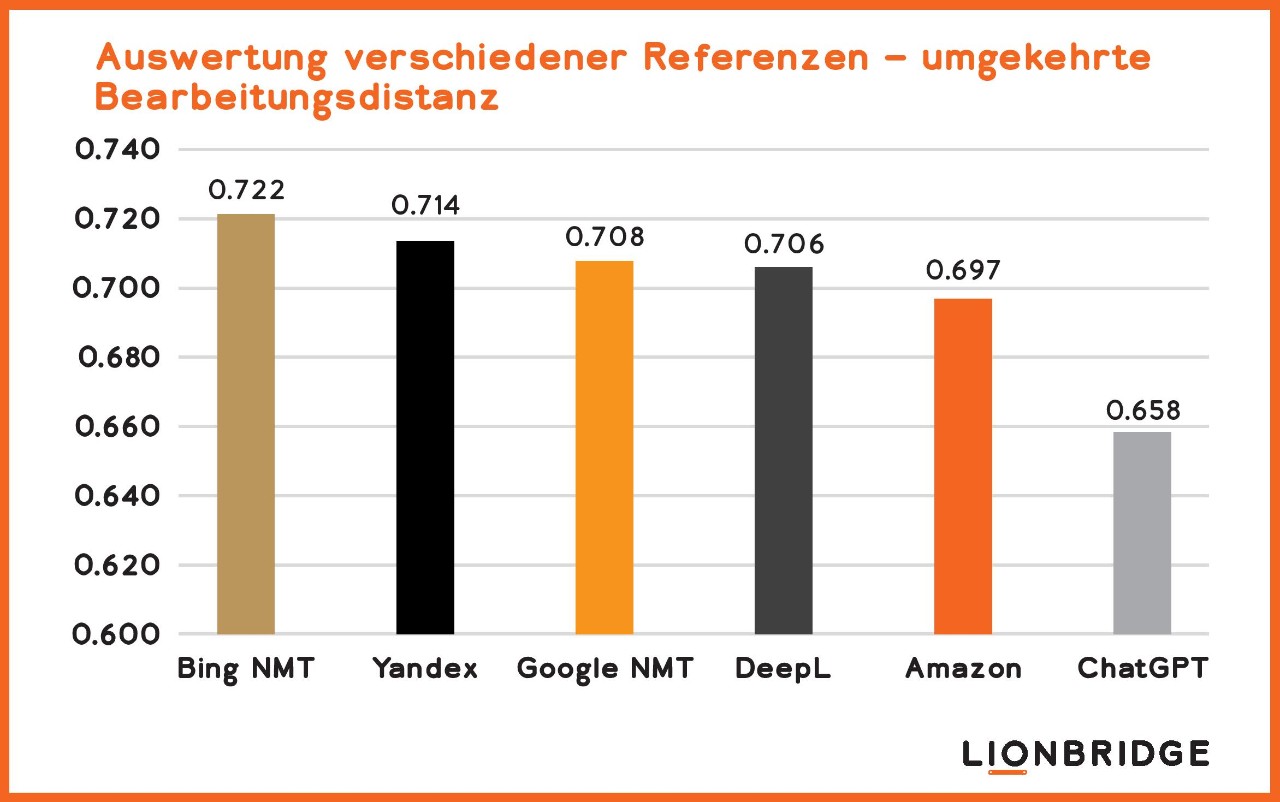

Wie erwartet ist die Übersetzungsqualität der spezialisierten NMT-Engines der von ChatGPT überlegen. Allerdings leistete der ChatGPT-Bot überraschend gute Arbeit. Wie in Abbildung 1 zu sehen, schneidet er sogar fast ebenso gut ab wie die spezialisierten Engines.

Wie haben wir die Qualität von ChatGPT im Vergleich zu generischen MT-Engines bewertet?

Wir haben die Qualität der Engines auf der Grundlage der umgekehrten Bearbeitungsdistanz unter Verwendung mehrerer Referenzen für das Sprachpaar Englisch-Spanisch berechnet. Die Bearbeitungsdistanz misst dabei die Anzahl der Bearbeitungen, die ein Mensch an der MT-Ausgabe vornehmen müsste, damit das Niveau der resultierenden Übersetzung dem einer menschlichen Übersetzung entspricht. Für unsere Berechnung haben wir die reine MT-Ausgabe mit 10 verschiedenen menschlichen Übersetzungen – also mehreren Referenzen – verglichen, anstatt nur mit einer einzigen. Eine umgekehrte Bearbeitungsdistanz bedeutet, dass die Qualität umso besser ausfällt, je höher die resultierende Zahl ist.

Abbildung 1 – Vergleich der Qualität der automatischen Übersetzung zwischen ChatGPT und den wichtigsten MT-Engines auf der Grundlage der umgekehrten Bearbeitungsdistanz unter Verwendung mehrerer Referenzen für das Sprachpaar Englisch-Spanisch.

Warum sind die Ergebnisse der Übersetzungsleistung von ChatGTP so bemerkenswert?

Die Ergebnisse unserer vergleichenden Analyse sind deshalb so beachtlich, weil das generische Modell für viele verschiedene Aufgaben der natürlichen Sprachverarbeitung (Natural Language Processing, NLP) trainiert wurde – im Gegensatz zu der einzigen NLP-Aufgabe der Übersetzung, für die MT-Maschinen trainiert wurden. Und obwohl ChatGPT nicht speziell für die Ausführung von Übersetzungen trainiert wurde, ist die Leistung des Bots vergleichbar mit dem Qualitätsniveau der MT-Engines von vor zwei oder drei Jahren.

Lesen Sie unseren Blog, um mehr über ChatGTP und Übersetzung zu erfahren.

Wie könnte sich die maschinelle Übersetzung als Ergebnis großer Sprachmodelle entwickeln?

In Anbetracht des Wachstums von LLMs – basierend auf der öffentlichen Aufmerksamkeit und den beträchtlichen Investitionen von Unternehmen in diese Technologie – werden wir vielleicht schon bald sehen, ob ChatGPT die MT-Engines überholt oder ob die MT generell ein neues LLM-Paradigma annimmt.

Maschinelle Übersetzungen könnten in diesem Fall LLMs als Grundlage verwenden, um anschließend eine Feinabstimmung der Technologie für die maschinelle Übersetzung vorzunehmen. Das wäre vergleichbar mit den derzeitigen Aktivitäten von OpenAI und anderen LLM-Firmen, um ihre generischen Modelle für bestimmte Anwendungsfälle zu verbessern, z. B. damit Maschinen mit Menschen über Gespräche kommunizieren können. Die Spezialisierung erhöht die Genauigkeit der ausgeführten Aufgaben.

Was bringt die Zukunft für große Sprachmodelle im Allgemeinen?

Das Spannende an diesen großen „generischen” Sprachmodellen ist, dass sie so viele verschiedene Dinge tun können und bei den meisten ihrer Aufgaben hervorragende Qualität bieten. So wurde beispielsweise GATO von DeepMind, ein weiteres allgemeines Intelligenzmodell, in mehr als 600 Aufgaben getestet und erzielte in 400 davon Ergebnisse, die auf dem aktuellen Stand der Technik (State Of The Art, SOTA) sind.

Zwei Entwicklungslinien wird es auch in Zukunft geben: generische Modelle wie GPT, Megatron und GATO und spezialisierte Modelle für bestimmte Zwecke, die auf diesen generischen Modellen basieren.

Die generischen Modelle sind wichtig, um die künstliche generische Intelligenz (Artificial Generic Intelligence, AGI) voranzutreiben und möglicherweise längerfristig noch beeindruckendere Entwicklungen zu ermöglichen. Spezialisierte Modelle werden auf kurze Sicht für bestimmte Bereiche praktische Verwendung finden. Bemerkenswert an LLMs ist, dass sich beide Linien parallel zueinander weiterentwickeln und funktionieren können.

Was sind die Auswirkungen eines Paradigmenwechsels in der maschinellen Übersetzung?

Da das derzeitige Technologieparadigma der neuronalen maschinellen Übersetzung an seine Grenzen stößt und ein neues entstehen und bald schon dominieren wird – wahrscheinlich auf der Grundlage von LLMs –, rechnen wir mit einigen Veränderungen in der Branche. Die meisten Auswirkungen werden den Unternehmen zugute kommen. Es wird aber auch zusätzliche Herausforderungen geben – gerade für Unternehmen, die auf menschliche Übersetzungen bauen.

Mit Folgendem ist zu rechnen:

Höhere Qualität

Es wird einen Qualitätssprung in der maschinellen Übersetzung geben, da der technologische Fortschritt seit langem bestehende Probleme löst, wie z. B. formelle und informelle Sprache bei maschinellen Übersetzungen sowie andere Qualitätsprobleme in Bezug auf den Umgangston. LLMs könnten sogar das größte Problem der maschinellen Übersetzung lösen: den Mangel an Wissen über die Welt. Diese Leistung könnte durch ihr multimodales Training realisiert werden.

Techniker können moderne LLMs nicht nur mit riesigen Textmengen, sondern auch mit Bildern und Videos trainieren. Durch diese Art des Trainings verfügen LLMs über ein stärker vernetztes Wissen, wodurch die Maschinen die Bedeutung der Texte besser interpretieren können.

Mehr Inhalte und ein geringeres Angebot an hochkarätigen Übersetzern

Unternehmen werden in der Lage sein, mehr Inhalte schneller zu erstellen. Dieses erhöhte Volumen wird das Wachstum des Pools von Sprachexperten, die diese Inhalte übersetzen können, irgendwann übersteigen. Selbst mit verbesserter maschineller Übersetzung und erhöhter Produktivität der Übersetzer wird die Community weiterhin damit kämpfen, die Nachfrage nach Übersetzungen zu erfüllen.

Zunehmende Akzeptanz von maschinellen Übersetzungen

In dem Maße, in dem das neue Technologieparadigma verfügbar wird und die Qualität der maschinellen Übersetzung steigt, wird auch die Nachfrage nach Übersetzungsdiensten weiter ansteigen und die MT-Akzeptanz immer mehr zunehmen.

Der Einsatz von maschineller Übersetzung zur Verbesserung des Kundenerlebnisses

Mit der verbesserten Qualität der maschinellen Übersetzung und dem Bedarf an personalisierten und maßgeschneiderten Kundenerlebnissen werden Unternehmen MT immer häufiger einsetzen, um die digitalen Erfahrungen ihrer globalen Kunden zu verbessern und stärkere Beziehungen aufzubauen.

Fazit

Technologieunternehmen zeigen großes Interesse an der LLM-Technologie. Microsoft investiert 10 Milliarden Dollar in OpenAI. Nvidia, Google und andere Unternehmen investieren ebenfalls stark in die LLM- und KI-Technologie.

Wir sind gespannt, was die Zukunft bringt, und werden uns auch weiterhin mit LLMs beschäftigen. Halten Sie sich hier über diese hochinteressante Entwicklung auf dem Laufenden.

Nehmen Sie Kontakt mit uns auf

Wenn Sie erfahren möchten, wie Lionbridge Sie dabei unterstützen kann, das Potenzial der maschinellen Übersetzung voll auszuschöpfen, dann kontaktieren Sie uns noch heute.